Un equipo de investigación de las universidades de Jaén y Alicante ha testado un modelo basado en inteligencia artificial que determina la veracidad de las informaciones en medios digitales. Mediante la aplicación de esta herramienta, tanto periodistas como usuarios finales podrán defenderse de las fake news.

Un equipo de investigación de las universidades de Jaén y Alicante ha testado un modelo basado en inteligencia artificial que determina la veracidad de las informaciones en medios digitales. Mediante la aplicación de esta herramienta, tanto periodistas como usuarios finales podrán defenderse de las fake news.

Los investigadores han creado una aplicación que analiza las noticias de forma automática y determina la veracidad de éstas con una alta precisión. Aunque el modelo está aún en fase de testeo, se propone como una herramienta útil para filtrar la cantidad de información que llega cada día a periodistas y lectores y detectar las fake news.

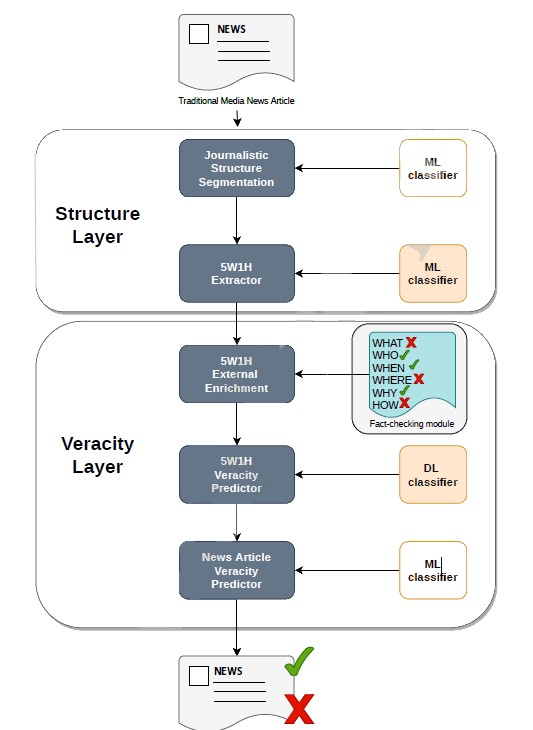

Basado en técnicas de inteligencia artificial, el sistema testea la noticia en dos niveles detectando si existen incongruencias en el contenido y si la estructura coincide con la que cualquier publicación con rigor periodístico debe tener.

Con el objetivo de ofrecer una mayor confianza al lector y dotar a los periodistas de nuevas herramientas que le permitan discernir entre diversas informaciones, los investigadores han publicado en la revista Expert Systems with Applications un artículo titulado «Exploiting discourse structure of traditional digital media to enhance automatic fake news detection» en el que presentan el prototipo de un detector de fake news para webs.

fake news y pirámide invertida

El sistema analiza la estructura de la noticia publicada atendiendo a las normas de periodismo clásicas: la regla de las 5W+H, conocida así por las siglas de las cuestiones en inglés, y la pirámide invertida. Estas guías se sustentan en que la noticia rigurosa debe contener información que responda a las seis preguntas básicas (¿qué?, ¿cuándo?, ¿dónde?, ¿quién?, ¿por qué? y ¿cómo?) y que se presente en gradación desde lo más importante hasta los detalles. “La estructura de una publicación nos da pistas de si hay base periodística o si, por el contrario, imita a una noticia real”, indica a la Fundación Descubre el investigador de la Universidad de Jaén, Miguel Ángel García, autor del artículo.

A partir del análisis del lenguaje natural, los expertos desarrollan un algoritmo que detecta las informaciones que no responden a esta estructura. Estos cálculos se basan en técnicas de aprendizaje automático, también conocido como machine learning, de forma que el sistema va ‘aprendiendo’ a medida que va acumulando datos.

Además, la máquina puede procesar en segundos miles de datos simultáneos, algo que una persona no podría hacer. “Así, los periodistas pueden contrastar fuentes, detectar estructuras incorrectas, viralizadas, o que tengan incongruencias entre el titular y el cuerpo de manera inmediata y automática. También el usuario final puede tener evidencias de si la noticia que lee cumple con unos estándares o no”, añade la investigadora de la Universidad de Alicante Estela Saquete, también autora del artículo.

Analizar, detectar y resaltar para alertar

Los equipos ‘Sistemas Inteligentes de Acceso a la información’ (SINAI), de la Universidad de Jaén, y ‘Grupo de Procesamiento del Lenguaje Natural y Sistemas de Información’ (GPLSI), de la Universidad de, Alicante, realizaron las pruebas sobre un conjunto de datos en español con más de 200 artículos centrados en temas sanitarios, de especial relevancia en la actualidad debido a las numerosas noticias falsas que circulan sobre COVID-19.

El sistema toma como base el aprendizaje profundo, con el que se crean modelos computacionales compuestos por varias capas de procesamiento de datos. Concretamente en este trabajo, los expertos definen dos capas. Por un lado la estructura de la noticia y por otro el argumento. De esta manera, la máquina predice no sólo la credibilidad de la forma, sino también del contenido.

El objetivo de los expertos es lograr una aplicación que marque automáticamente el texto de una fake news mientras se lee y que alerte mediante una señal de partes de la noticia que puedan ser falsas, indicando la referencia con otros textos similares en los que se pueda contrastar su veracidad.

Esta investigación se ha desarrollado mediante los proyectos ‘LIVING-LANG: Modelado del comportamiento de entidades digitales mediante Tecnologías del Lenguaje Humano’ del Ministerio de Ciencia e Innovación y ‘SIIA: Tecnologías del lenguaje humano para una sociedad inclusiva, igualitaria, y accesible’ de la Comunidad Valenciana.